Kecerdasan buatan (AI) telah memasuki kesadaran publik berkat munculnya chatbot AI baru dan generator gambar yang kuat. Namun bidang ini memiliki sejarah panjang awal komputasi. Mengingat betapa mendasarnya AI dapat mengubah cara hidup kita di tahun-tahun mendatang, memahami akar permasalahan dari bidang yang berkembang pesat ini sangatlah penting. Berikut adalah 12 pencapaian dalam sejarah AI.

1950 – Makalah AI Alan Turing

Ilmuwan komputer terkenal asal Inggris Alan Turing diterbitkan selembar kertas berhak “Mesin Komputasi dan Kecerdasan,” yang merupakan salah satu penyelidikan mendetail pertama atas pertanyaan “Dapatkah mesin berpikir?”.

Untuk menjawab pertanyaan ini, Anda harus terlebih dahulu mengatasi tantangan dalam mendefinisikan “mesin” dan “berpikir”. Jadi, dia malah mengusulkan sebuah permainan: Seorang pengamat akan mengamati percakapan antara mesin dan manusia dan mencoba menentukan percakapan mana yang mana. Jika mereka tidak dapat melakukannya dengan andal, mesin akan memenangkan permainan. Meskipun hal ini tidak membuktikan adanya mesin yang “berpikir”, Uji Turing – sebagaimana diketahui – telah menjadi tolak ukur penting bagi kemajuan AI sejak saat itu.

1956 – Lokakarya Dartmouth

AI sebagai suatu disiplin ilmu dapat menelusuri akarnya kembali Proyek Penelitian Musim Panas Dartmouth tentang Kecerdasan Buatan, diadakan di Dartmouth College pada tahun 1956. Para pesertanya adalah sekelompok ilmuwan komputer berpengaruh, termasuk John McCarthy, Marvin Minsky, dan Claude Shannon. Ini adalah pertama kalinya istilah “kecerdasan buatan” digunakan ketika kelompok tersebut menghabiskan hampir dua bulan mendiskusikan bagaimana mesin dapat mensimulasikan pembelajaran dan kecerdasan. Pertemuan tersebut memulai penelitian serius terhadap AI dan meletakkan dasar bagi banyak penemuan di masa depan pada dekade-dekade berikutnya.

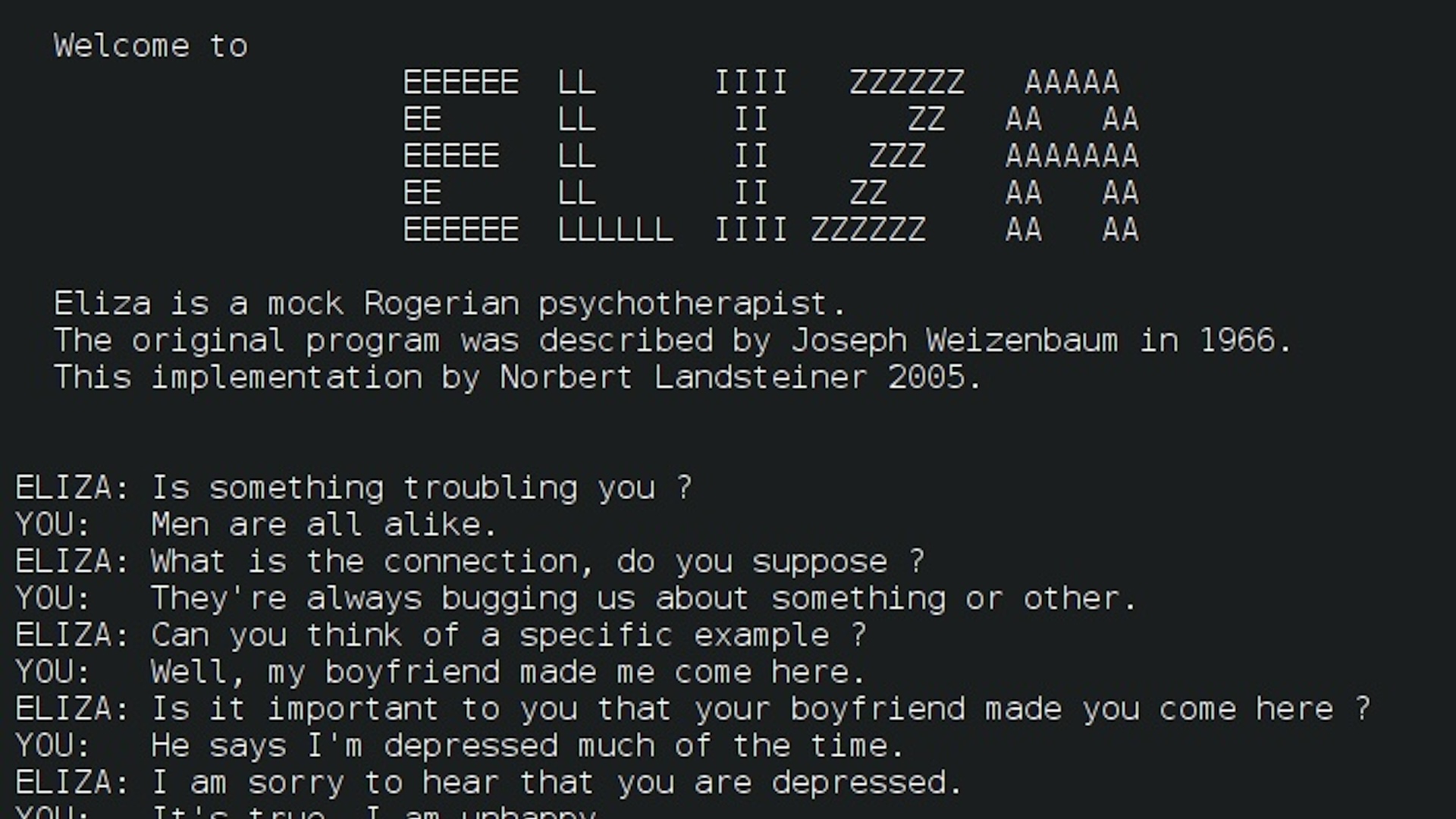

1966 — Chatbot AI pertama

Peneliti MIT Joseph Weizenbaum meluncurkan chatbot AI pertama, yang dikenal sebagai ELIZA. Perangkat lunak dasarnya adalah dasar dan mengeluarkan tanggapan terekam berdasarkan kata kunci yang terdeteksi di prompt. Namun, ketika Weizenbaum memprogram ELIZA untuk bertindak sebagai psikoterapis, orang-orang dilaporkan kagum dengan betapa meyakinkannya percakapan tersebut. Pekerjaan itu merangsang pertumbuhan tertarik pada pemrosesan bahasa alamitermasuk dari Badan Proyek Penelitian Lanjutan Pertahanan AS (DARPA), yang menyediakan dana besar untuk penelitian awal AI.

1974-1980 — “Musim dingin AI” yang pertama.

Tidak butuh waktu lama sebelum antusiasme awal terhadap AI mulai memudar. Tahun 1950-an dan 1960-an adalah masa yang subur bagi bidang ini, namun di tengah kegembiraan mereka, para ahli terkemuka membuat klaim yang berani tentang apa yang dapat dilakukan mesin dalam waktu dekat. Kegagalan teknologi untuk memenuhi harapan tersebut menyebabkan meningkatnya ketidakpuasan. A laporan yang sangat kritis di lapangan oleh ahli matematika Inggris James Lighthill memimpin pemerintah Inggris untuk memotong hampir semua pendanaan untuk penelitian AI. DARPA juga secara drastis memotong pendanaan selama periode ini, yang mengarah pada apa yang dikenal sebagai “musim dingin AI” yang pertama.

1980 – “Sistem pakar” terburu-buru

Meskipun banyak pihak yang kecewa terhadap AI, penelitian terus dilakukan – dan pada awal tahun 1980-an, teknologi ini mulai menarik perhatian sektor swasta. Pada tahun 1980, para peneliti di Universitas Carnegie Mellon membangun a Sistem AI disebut R1 untuk Perusahaan Peralatan Digital. Program ini adalah sebuah “sistem pakar” – sebuah pendekatan terhadap AI yang telah diujicobakan oleh para peneliti sejak tahun 1960an. Sistem ini menggunakan aturan logis untuk menalar melalui database besar pengetahuan pakar. Program ini menghemat jutaan dolar bagi perusahaan setiap tahunnya dan memulai ledakan penggunaan sistem pakar di industri.

1986 – Dasar-dasar pembelajaran mendalam

Sebagian besar penelitian hingga saat ini berfokus pada AI “simbolis”, yang mengandalkan logika buatan tangan dan basis data pengetahuan. Namun sejak lahirnya bidang ini, terdapat pula aliran penelitian tandingan mengenai pendekatan “koneksionis” yang diilhami oleh otak. Hal ini terus berlanjut secara diam-diam dan akhirnya terungkap pada tahun 1980an. Alih-alih memprogram sistem dengan tangan, teknik ini melibatkan membujuk “jaringan syaraf tiruan” untuk mempelajari aturan dengan melatih data. Secara teori, hal ini akan menghasilkan AI yang lebih fleksibel dan tidak dibatasi oleh prasangka pembuatnya, namun melatih jaringan saraf terbukti menantang. Pada tahun 1986, Geoffrey Hinton, yang kemudian dijuluki sebagai salah satu “bapak baptis pembelajaran mendalam”, menerbitkan bukunya selembar kertas mempopulerkan “propagasi mundur” — teknik pelatihan yang mendasari sebagian besar sistem AI saat ini.

1987-1993 — Musim dingin AI kedua

Berdasarkan pengalaman mereka pada tahun 1970-an, Minsky dan rekan peneliti AI Roger Schank memperingatkan bahwa perkembangan AI telah mencapai tingkat yang tidak berkelanjutan dan bidang ini berada dalam bahaya kemunduran lagi. Mereka menciptakan istilah “AI musim dingin” di Diskusi panel pada pertemuan Masyarakat untuk Kemajuan Kecerdasan Buatan tahun 1984. Peringatan mereka terbukti benar, dan pada akhir tahun 1980-an, keterbatasan sistem pakar dan perangkat keras AI khusus mereka mulai terlihat. Pengeluaran industri untuk AI menurun drastis, dan banyak perusahaan AI yang masih baru mengalami kebangkrutan.

1997 — Deep Blue mengalahkan Garry Kasparov

Meskipun terjadi booming dan kegagalan berulang kali, penelitian AI mengalami kemajuan yang stabil pada tahun 1990an dan sebagian besar tidak terlihat oleh publik. Hal ini berubah pada tahun 1997, ketika Deep Blue – sistem pakar yang dibangun oleh IBM – mengalahkan juara catur dunia Garry Kasparov di enam seri permainan. Kemahiran dalam permainan yang kompleks telah lama dilihat oleh para peneliti AI sebagai penanda utama kemajuan. Oleh karena itu, mengalahkan pemain manusia terbaik di dunia dipandang sebagai peristiwa besar dan menjadi berita utama di seluruh dunia.

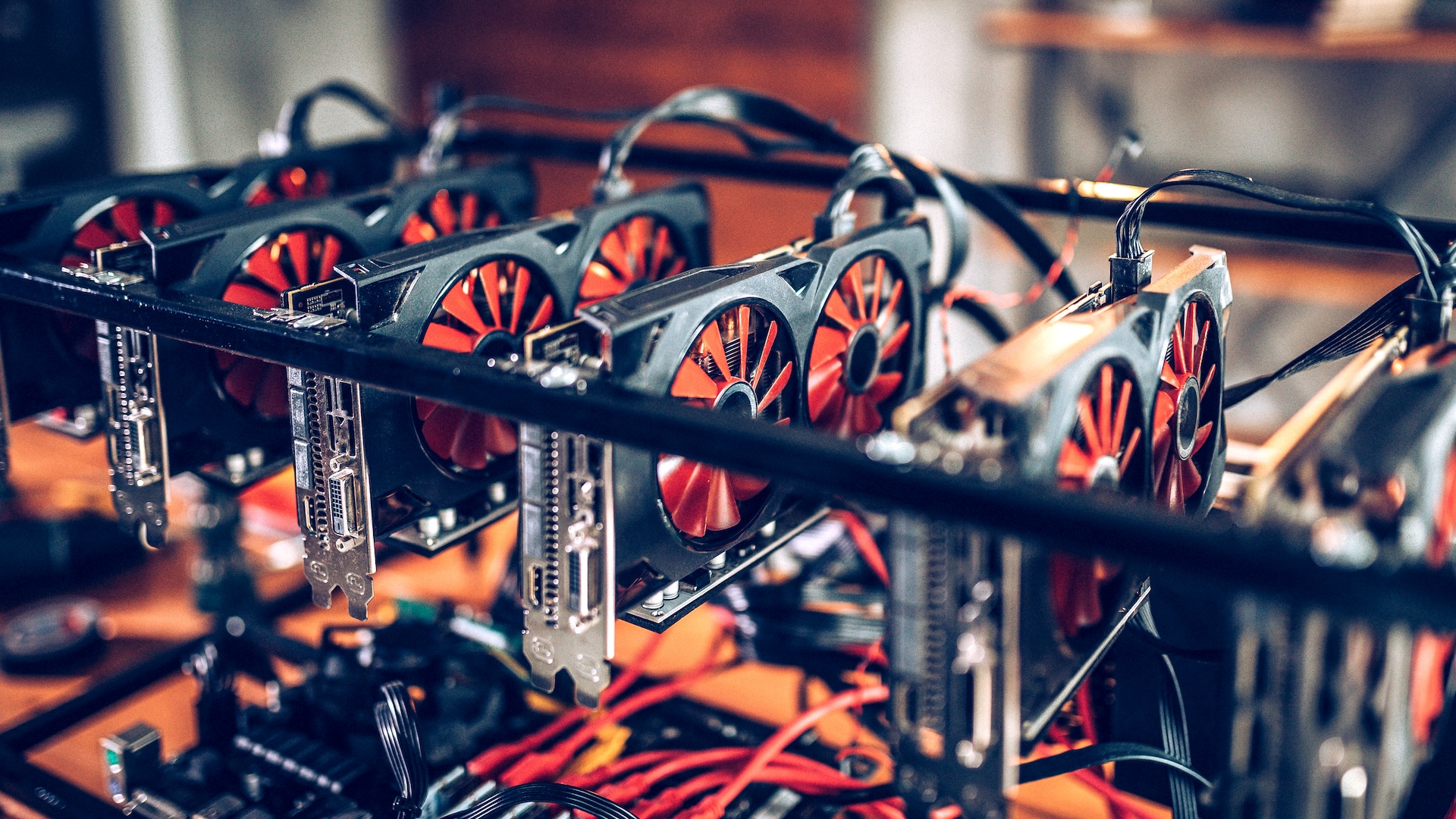

2012 — AlexNet mengantarkan era pembelajaran mendalam

Meskipun banyak penelitian akademis, jaringan saraf dipandang tidak praktis untuk aplikasi dunia nyata. Agar berguna, mereka perlu memiliki banyak lapisan neuron, namun penerapan jaringan besar pada perangkat keras komputer konvensional sangatlah tidak efisien. Pada tahun 2012, Alex Krizhevsky, seorang mahasiswa doktoral Hinton, memenangkan kompetisi visi komputer ImageNet dengan selisih yang besar dengan model pembelajaran mendalam yang disebut AlexNet. Rahasianya adalah dengan menggunakan chip khusus yang disebut unit pemrosesan grafis (GPU) yang dapat menjalankan jaringan yang lebih dalam secara efisien. Hal ini menjadi landasan bagi revolusi pembelajaran mendalam yang telah mendorong sebagian besar kemajuan AI sejak saat itu.

2016 — AlphaGo mengalahkan Lee Sedol

Meskipun AI telah meninggalkan catur di kaca spionnya, permainan papan Tiongkok Go yang jauh lebih kompleks masih tetap menjadi tantangan. Namun pada tahun 2016, Google DeepMind AlfaGo mengalahkan Lee Sedol, salah satu pemain Go terhebat di dunia, dalam seri lima pertandingan. Para ahli mengira bahwa pencapaian tersebut masih akan terjadi dalam beberapa tahun ke depan, sehingga hasilnya semakin meningkatkan antusiasme terhadap kemajuan AI. Hal ini sebagian disebabkan oleh sifat umum dari algoritma yang mendasari AlphaGo, yang mengandalkan pendekatan yang disebut “pembelajaran penguatan”. Dalam teknik ini, sistem AI belajar secara efektif melalui trial and error. DeepMind kemudian memperluas dan meningkatkan pendekatan penciptaan AlfaZeroyang bisa belajar sendiri memainkan berbagai jenis permainan.

2017 — Penemuan arsitektur transformatif

Meskipun ada kemajuan signifikan dalam visi komputer dan game, pembelajaran mendalam mengalami kemajuan yang lebih lambat dalam tugas-tugas bahasa. Kemudian, pada tahun 2017, peneliti Google menerbitkan arsitektur jaringan saraf baru yang disebut “transformator”, yang dapat menyerap data dalam jumlah besar dan membuat koneksi antar titik data yang jauh. Hal ini terbukti sangat berguna untuk tugas kompleks pemodelan bahasa dan memungkinkan terciptanya AI yang dapat menangani banyak tugas secara bersamaan, seperti penerjemahan, pembuatan teks, dan peringkasan dokumen. Semua model AI terkemuka saat ini mengandalkan arsitektur ini, termasuk generator gambar seperti OpenAI DALL-Eserta model pelipatan protein revolusioner Google DeepMind Lipat Alfa 2.

2022 – Peluncuran ChatGPT

Pada tanggal 30 November 2022, OpenAI merilis chatbot yang didukung oleh model bahasa besar GPT-3. Dikenal sebagai “Obrolan GPT,” alat ini menjadi sensasi di seluruh dunia, mendapatkan lebih dari satu juta pengguna dalam waktu kurang dari seminggu dan 100 juta pada bulan berikutnya. Ini adalah pertama kalinya orang dapat berinteraksi dengan model AI terbaru — dan sebagian besar dari mereka terpesona. Layanan ini dikreditkan dengan memulai ledakan AI yang menghasilkan miliaran dolar yang diinvestasikan di bidang ini dan melahirkan banyak peniru dari perusahaan teknologi besar dan perusahaan rintisan. surat Terbuka dari para pemimpin teknologi terkemuka yang menyerukan penghentian penelitian AI untuk memberikan waktu menilai implikasi teknologi.